©Manuela Machner

©Manuela Machnerartikel

26. Apr. 2026

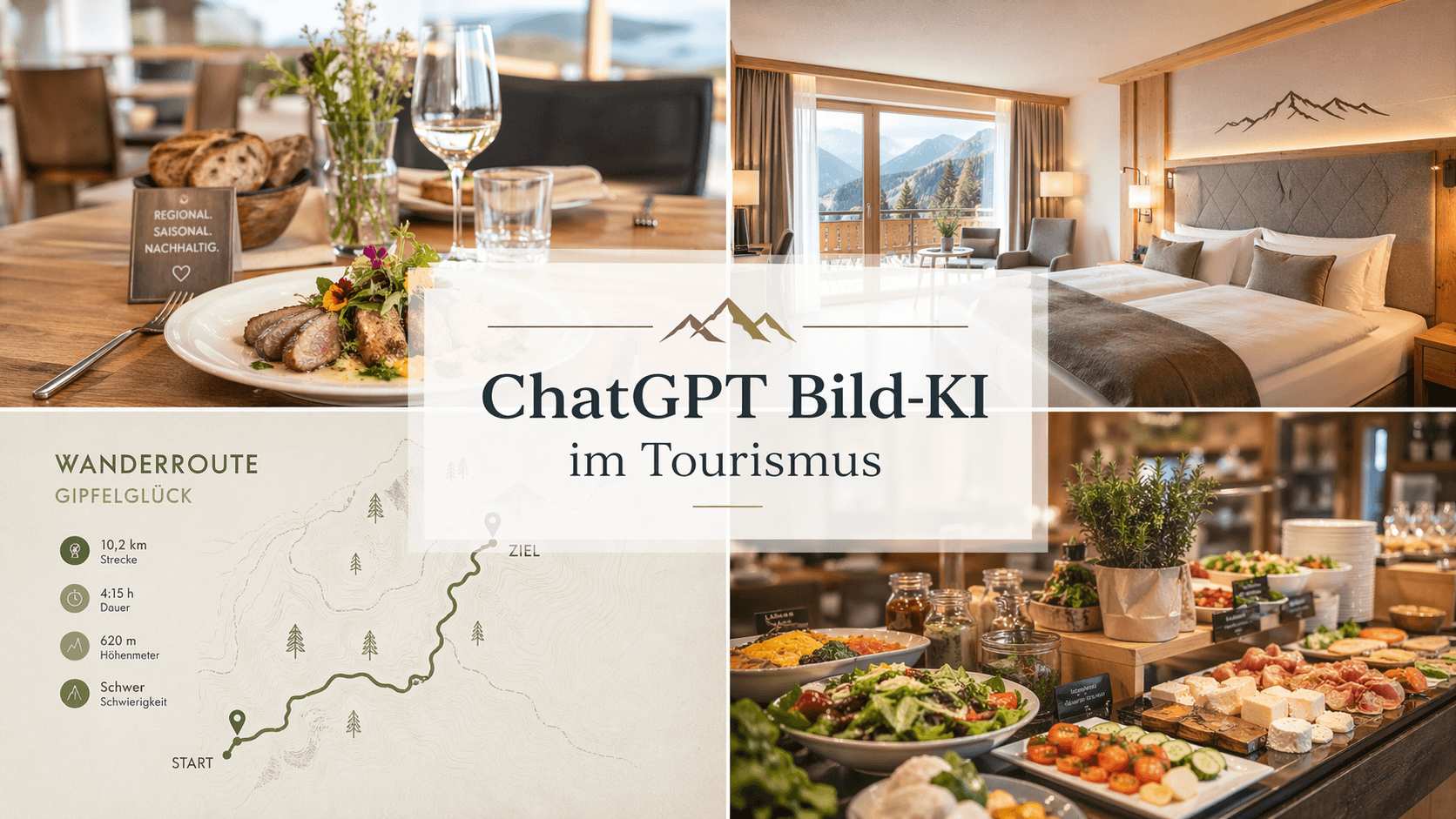

Die KI kann jetzt richtig Bilder - ChatGPT und seine neue Bild-KI

Künstliche Intelligenz

Digitalisierung

Ich teste KI-Tools seit Jahren – beruflich und mit einem gesunden Maß an Skepsis. Die neue Bildgenerierung von ChatGPT hat mich trotzdem überrascht. Nicht weil sie perfekt ist, sondern weil sie gut genug ist, um echte Fragen aufzuwerfen. Für die Branche, aber auch für jeden Betrieb und jede Destination, die mit Bildern Erwartungen weckt.

Bildgenerierung per KI ist kein Experiment mehr

Mit der aktuellen Version von ChatGPT ist sie für viele Anwendungen in der Tourismusbranche tatsächlich einsatzbereit.

Das ist eine Feststellung, keine Werbebotschaft.

Was ich ausprobiert habe

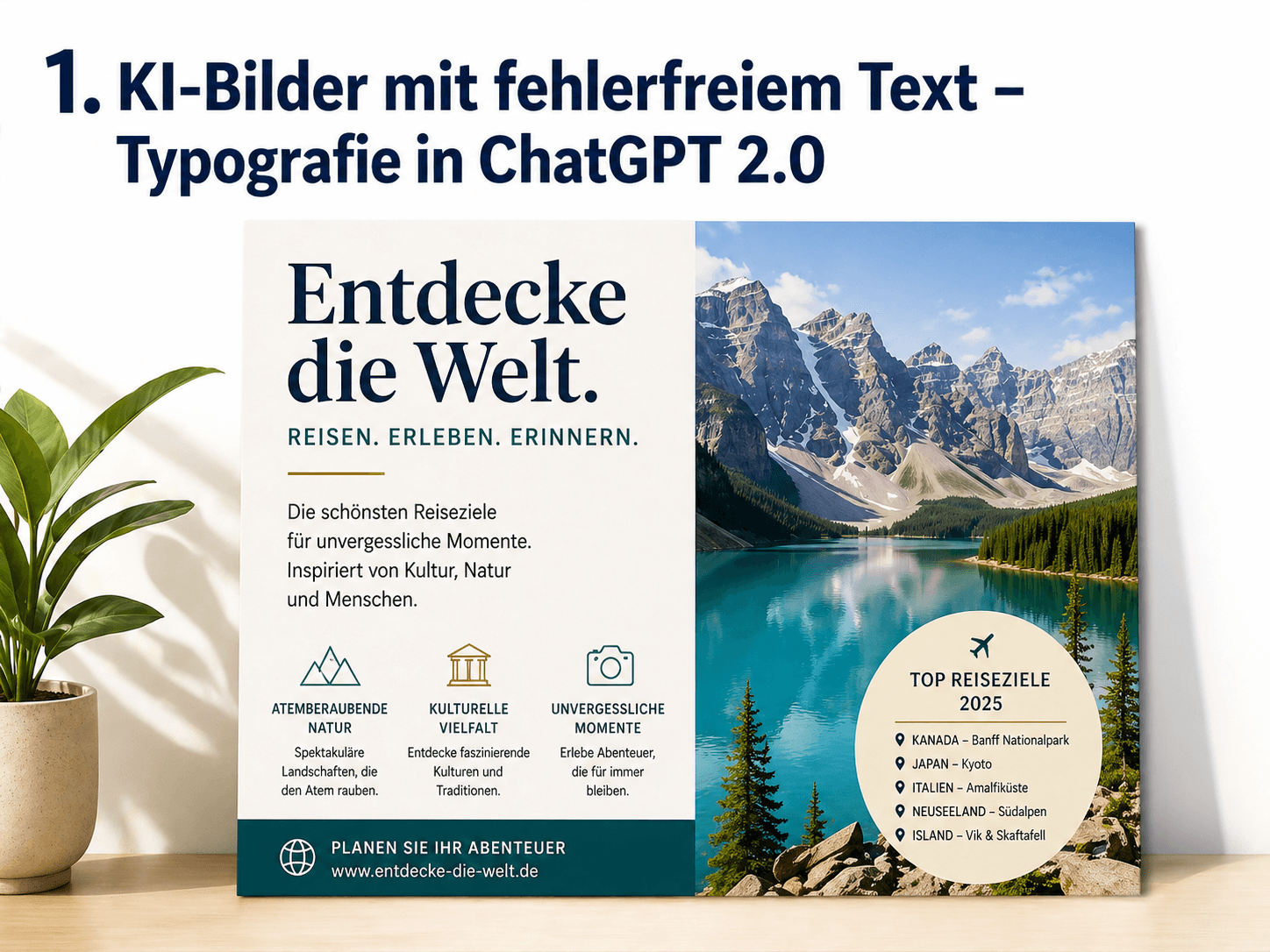

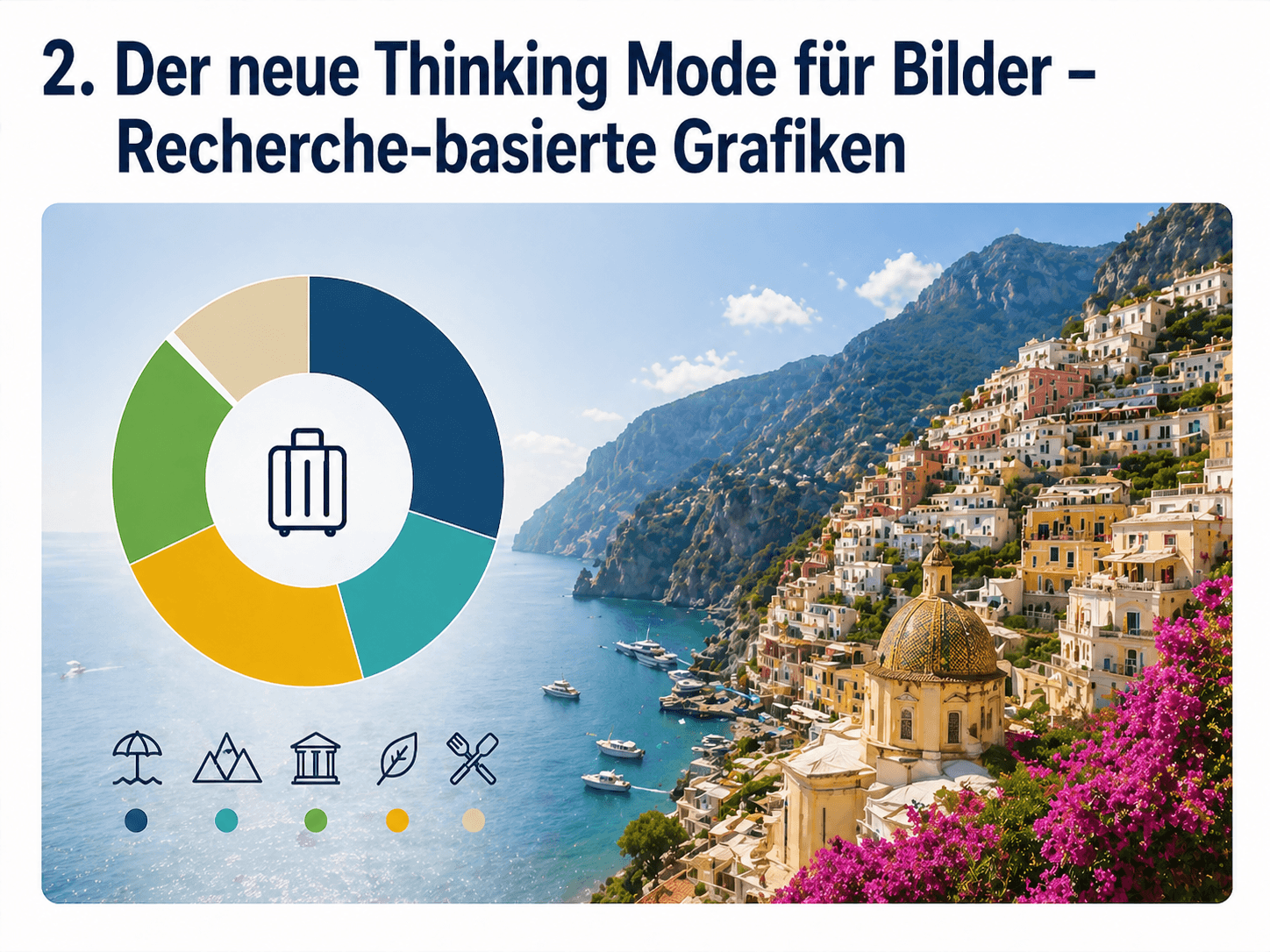

Die neue Version löst mehrere dieser Probleme gleichzeitig. Ein paar konkrete Beispiele aus meinen Tests:

- Ein Roboter-Charakter, den ich in verschiedene österreichische Szenen gesetzt habe, sah in jedem Bild gleich aus. Konsistenz über Szenen hinweg war bisher eine der größten Schwächen dieser Tools. Hier hat es einfach funktioniert.

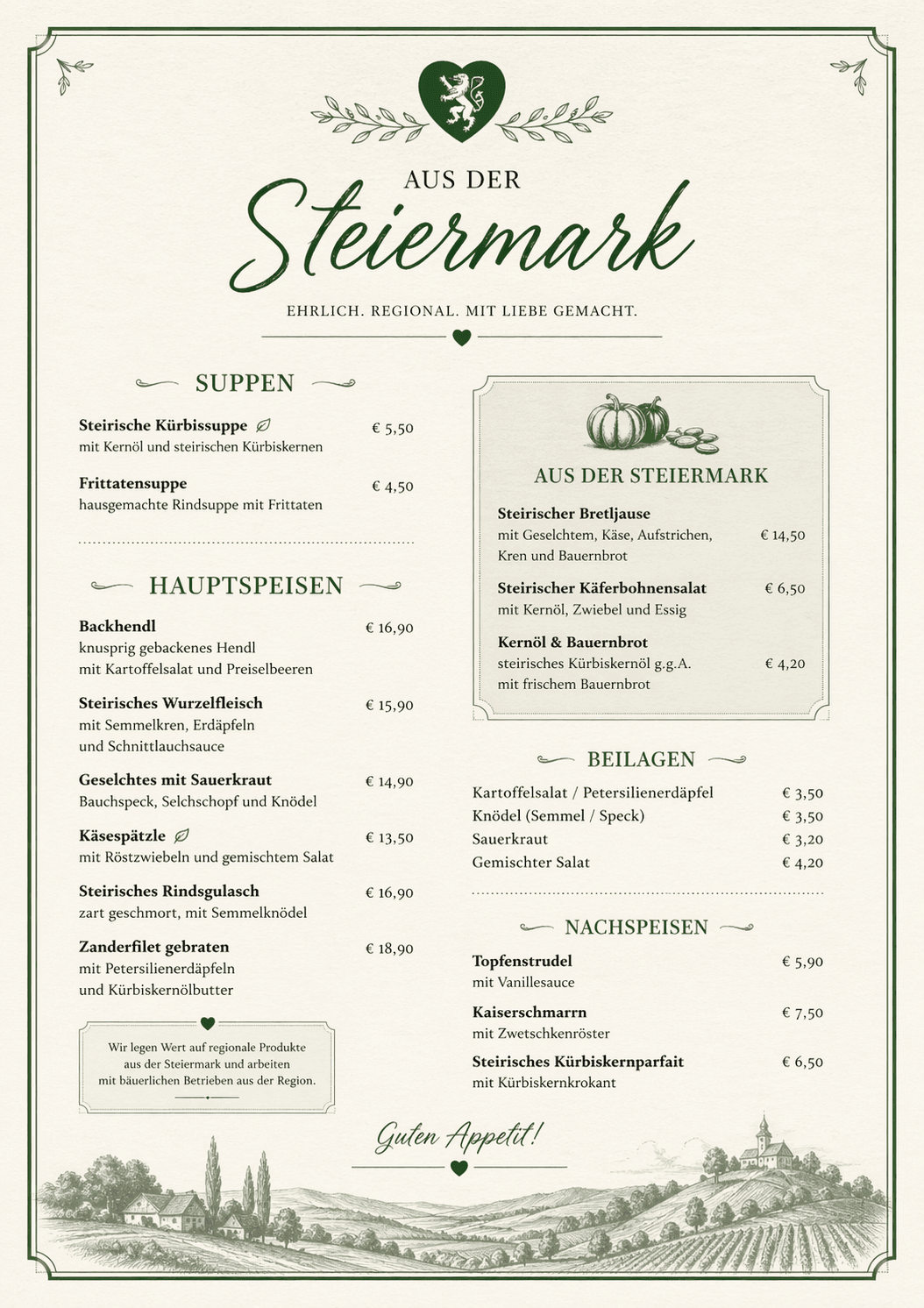

- Recherche und Design in einem Schritt - wie bei der Speisekarte. Thinking Mode in der Bildgenerierung.

- Salzburger Nockerl, Brettljause, regionale Gerichte: visuell überzeugend umgesetzt. Bei kleinen Details wie Markenlogos auf Produkten passieren noch Fehler, aber das Motiv an sich stimmt.

- Ich habe das Tool gebeten, ein bestehendes Produktbild zu analysieren und eine optimierte Version zu erstellen. Das Ergebnis war so brauchbar, dass ich kurz ernsthaft über mein Canva-Abo nachgedacht habe.

- Formate lassen sich direkt wählen, von quadratisch für Instagram bis 9:16 für Stories bis Querformat für Präsentationen. Kein Nachbearbeiten, kein Zuschneiden.

Konkrete Anwendungsfelder für die Branche

Für Destinationen und Betriebe, die regelmäßig visuelle Inhalte brauchen, ergeben sich jetzt realistische Einsatzmöglichkeiten:

- Konzeptentwürfe für Kampagnen lassen sich in Minuten visualisieren, bevor ein Fotoshooting geplant wird.

- Saisonale Motive können schnell und kostengünstig variiert werden.

- Produktbilder lassen sich auf Wirkung prüfen, bevor sie in Produktion gehen.

- Infografiken für Präsentationen entstehen ohne Grafikprogramm.

Das ersetzt keine professionelle Fotografie – aber es verändert, welche Aufgaben zwingend extern vergeben werden müssen, und welche intern erledigt werden können.

Die eigentliche Gefahr: Dinge zeigen, die nicht existieren

Je realistischer KI-Bilder werden, desto größer wird ein spezifisches Risiko, das im Tourismus besonders schwer wiegt: falsche Versprechen. Ein Zimmer, das schöner aussieht als es ist. Eine Aussicht, die so nicht existiert. Ein Badestrand am See, der in der Realität zehn Minuten Fußweg entfernt und halb so groß ist. Eine Stimmung, die nur im Bild stimmt. Das klingt dramatisch, passiert aber schnell. Nicht aus böser Absicht, sondern weil das Tool so einfach zu bedienen ist und die Ergebnisse so überzeugend wirken. Man optimiert, verfeinert, verbessert, und irgendwann zeigt das Bild nicht mehr den Betrieb, sondern eine idealisierte Version davon. Die Konsequenz kennt die Branche: Gäste kommen mit Erwartungen, die vor Ort nicht erfüllt werden. Bewertungen fallen enttäuscht aus, obwohl das Angebot objektiv gut ist. Der Schaden entsteht nicht durch das Produkt, sondern durch die Lücke zwischen Bild und Wirklichkeit.

➡️ Im Tourismus ist diese Lücke kein Marketing- sondern ein Vertrauensproblem.

Das Risiko, das sich einschleicht: aufhören zu schauen

Wer jahrelang mit fehlerhaften KI-Bildern gearbeitet hat, hat sich eine Gewohnheit angewöhnt: prüfen, korrigieren, hinterfragen. Das war anstrengend, aber es hat die Kontrolle gesichert. Je besser das Tool wird, desto mehr verschwindet dieser Reflex. Man schaut hin, es sieht gut aus, man verwendet es. Der Kontrollschritt fällt weg, nicht bewusst, sondern weil er sich nicht mehr notwendig anfühlt.

Genau das ist das Problem: Nicht die Fehler, die man sieht, sondern die, die man nicht mehr sucht.

Im Tourismus, wo ein Bild eine Buchungsentscheidung auslöst und eine Erwartung setzt, die vor Ort eingelöst werden muss, ist das kein kleines Risiko. Es ist ein strukturelles.

Was das für die Praxis bedeutet

Das Tool hat echten Nutzen, wenn es für das eingesetzt wird, wofür es taugt: Konzepte visualisieren, Ideen skizzieren, Stimmungen testen. Nicht als Ersatz für authentische Fotografie, die zeigt, was tatsächlich da ist. Die Frage, die sich Betriebe und Destinationen jetzt stellen sollten, ist keine technische. Es ist eine strategische: Wo sind bei uns die Grenzen? Was darf KI-generiert sein, was nicht? Und wer entscheidet das?

💡 Einen ausführlichen Praxistest mit konkreten Beispielen gibt es hier: Zum Artikel auf kinet.ai

Habt ihr in euren Betrieben und Organisationen bereits Richtlinien, was erlaubt ist und was nicht? Wo zieht ihr die Grenze?

Manuela Machner ist KI-Beraterin mit Schwerpunkt Tourismus und Expertin für GEO-Optimierung im DACH-Raum. www.kinet.ai

Übrigens derzeit gibt es täglich Ideen, wie ihr die KI-BIldgenerierung in ChatGPT im Tourismus tatsächlich umsetzen könnt, mit Tipps & typischen Stolperfallen! Täglich auf Linkedin oder auf der website: www.kinet.ai

https://www.kinet.ai/post/chatgpt-bild-ki-tourismus

call to action

Die Zukunft

des Tourismus

aktiv mitgestalten.

Ähnliches